مدیرعامل شرکت «اپن ای.آی» در کنگره آمریکا مطرح کرد

درخواست مهار هوش مصنوعی

استاد دانشگاه نیویورک: ما ماشینهایی ساختهایم که مانند گاو در مغازه چینی فروشی هستند قدرتمند و بیپروا که کنترل کردن آنها دشوار است

۲۸ اردیبهشت ۱۴۰۲، ۱:۰۰

|پیام ما| نگرانیهای زیاد بابت رشد پدیده هوش مصنوعی در دنیای امروز، ابعاد مختلفی دارد. برخی نگران آینده شغلی خود هستند، برخی نگران از دست رفتن اخلاقیات و عواطف انسانی و برخی دیگر نگران خارج شدن این پدیده از کنترل انسان و بروز فجایع بزرگ. همین نگرانیها باعث شد تا کنگره ایالات متحده، «سم آلتمن» مدیرعامل شرکت «اپن ای.آی» سازنده ابزار مشهور هوش مصنوعی «چت جی.پی.تی» را برای بیان توضیحاتش فرا بخواند. نکته قابل تأمل این جلسه، درخواست آلتمن برای وضع مقررات هوش مصنوعی بود چرا که او هم گفت «ممکن است هوش مصنوعی به بیراهه برود.»

اعضای کمیته قضایی کنگره ایالات متحده روز سهشنبه این هفته، آلتمن را برای استماع توضیحاتش درباره هوش مصنوعی و چت جی.پی.تی فراخواندند. علاوه بر آلتمن، «گری مارکوس»، استاد روانشناسی و علوم عصبی دانشگاه نیویورک و «کریستینا مونتگومری»، مدیر ارشد بخش امنیت آی.بی.ام نیز به همراه آلتمن در این جلسه حضور داشتند. در این جلسه استماع هر سه فرد دعوتشده به شکلهای مختلف از فناوری هوش مصنوعی و تاثیرات مثبت آن بر جامعه دفاع کردند.

مارکوس در این جلسه گفت: «ما ماشینهایی ساختهایم که مانند گاو در مغازه چینی و بلور فروشی هستند: قدرتمند و بیپروا که کنترل کردن آنها دشوار است.» با این وجود او مدلهایی مشابه در جهان را پیشنهاد داد که یک آژانس نظارتی جهانی (مانند سازمان غذا و دارو) میتواند سازندگان را ملزم کند تا ایمنی هوش مصنوعی تولید شده را اثبات کنند. اما «ریچارد بلومنتال»، رئیس کمیته فرعی گروه حریم خصوصی، فناوری و قانون سنا معتقد بود که هوش مصنوعی چیزی شبیه به «بمب اتمی در مغازه چینیفروشی» است، نه گاو.

مدیرعامل «اپن ای.آی»: بدترین ترس من این است که ما در حوزه فناوری و صنعت آسیب قابل توجهی به جهان وارد کنیم

اجماع نظر درباره خطرات

این جلسه سه ساعت طول کشید اما برخلاف بسیاری جلسات مشابه دیگر، کمتر دارای چالشهای جدی بین دعوتشدگان و اعضای کنگره بود. خصوصا در جایی که هم آلتمن و هم سناتورهای حاضر در جلسه بیان کردند که «هوش مصنوعی میتواند به بیراهه برود.» در ابتدای این جلسه، سناتور «دیک دوربین» گفت که به خاطر نمیآورد که شرکتهای بخش خصوصی تا به حال برای تنظیم مقررات مربوط به هوش مصنوعی درخواستی به کنگره داده باشند.

سناتور «جاش هاولی» نیز به تحقیقاتی اشاره کرد که نشان میدهد «مدلهای زبان بزرگ» (LLM یا مدلهایی از هوش مصنوعی که قابلیت دریافت پارامترهای متعددی برای آموزش خود دارند) مانند چت جی.پی.تی قادرند تا با استفاده از رژیم رسانهای، افکار عمومی را به طور دقیق پیشبینی کنند. او از آلتمن پرسید «آیا افراد نمیتوانند با استفاده از این فناوری پاسخ خود را به دقت تنظیم کنند تا نظرات جامعه را به نفع تغییر دهند؟» آلتمن در پاسخ به این سوال گفت، این امکان که او آن را «اطلاعات نادرست تعاملی یک به یک» مینامد، یکی از بزرگترین نگرانیهایش است و وضع مقررات برای این موضوع «بسیار عاقلانه» خواهد بود.

او گفت: «بدترین ترس من این است که ما در حوزه فناوری و صنعت آسیب قابل توجهی به جهان وارد کنیم. من فکر میکنم که این آسیب میتواند به روشهای مختلف رخ دهد.»

اگرچه او توضیح بیشتری نداد، اما هشدارهای منتقدان از گسترش اطلاعات نادرست و سوگیری تا نابودی کامل حیات بیولوژیکی را شامل میشود. آلتمن ادامه داد: «من فکر میکنم ممکن است این فناوری کاملاً اشتباه پیش برود و ما میخواهیم در مورد آن صحبت کنیم. ما میخواهیم با دولت برای جلوگیری از این اتفاق کار کنیم.»

دو کارشناس هوش مصنوعی از نیاز به شفافیت صریح از سوی سازندگان هوش مصنوعی دفاع کردند تا کاربران همیشه بدانند که مثلاً چه زمانی در حال گفتوگو با یک ربات هستند

پیشنهاد وضع مقررات خاص

آلتمن یک طرح سه مادهای برای تنظیم قانون سازندگان هوش مصنوعی به کنگره ارائه کرد. ابتدا، او از ایجاد یک آژانس فدرال حمایت کرد که میتواند مجوزهایی را برای ایجاد مدلهای هوش مصنوعی بالاتر از آستانه مشخصی از قابلیتها اعطا کند. این آژانس همچنین میتواند آن مجوزها را در صورتی که مدلها دستورالعملهای ایمنی تعیینشده توسط دولت را برآورده نکنند، لغو کند.

دومین ماده پیشنهاد آلتمن، این بود که دولت باید استانداردهای ایمنی را برای مدلهای «هوش مصنوعی با قابلیت بالا» ایجاد کند (مانند جلوگیری از تکرار یک مدل) و تستهای عملکردی خاصی را که مدلها باید پاس کنند (مانند تأیید توانایی مدل برای تولید اطلاعات دقیق) را به وجود آورد. این استانداردها و تستها باید به نحوی باشند که از تولید نشدن محتوای خطرناک توسط هوش مصنوعی، اطمینان حاصل شود.

سومین ماده نیز، درخواست از قانونگذاران بود تا آنها تا از کارشناسان غیروابسته به سازندگان هوش مصنوعی یا دولت، بخواهند تا ممیزی مستقل انجام دهند. او هدف از این درخواست را کسب اطمینان از عملکرد ابزارهای هوش مصنوعی در چارچوب دستورالعملهای قانونی دانست.

مارکوس و مونگومری نیز هر دو از نیاز به شفافیت صریح از سوی سازندگان هوش مصنوعی دفاع کردند تا کاربران همیشه بدانند که مثلاً چه زمانی در حال گفتوگو با یک ربات هستند.

به نظر میرسد که اتحادیه اروپا در تنظیم مقررات مربوط به برنامههای کاربردی هوش مصنوعی زودتر عمل کردهاند. این اتحادیه در حال بررسی این موضوع است که آیا فناوری هوش مصنوعی با اهداف کاربری عمومی (که ابزارهایی مانند چت جی.پی.تی بر اساس آن ساخته شده است) را به عنوان «پرخطر» طبقهبندی کند یا خیر. از آنجایی که اتحادیه اروپا این فناوری را تحت سختترین سطح مقررات قرار میدهد، بسیاری از شرکتهای فناوری بزرگ مانند گوگل و مایکروسافت به عنوان بزرگترین سرمایهگذار شرکت اپن ای.آی، علیه چنین طبقهبندی در اروپا لابی کردهاند و استدلال میکنند که چنین اقدامی، نوآوری را خفه میکند.

نگرانیها در مورد هوش مصنوعی، صدها نفر از بزرگترین نامهای فناوری از جمله «ایلان ماسک» را بر آن داشت تا دو ماه پیش نامهای سرگشاده را امضا کنند و از آزمایشگاههای هوش مصنوعی بخواهند آموزش سیستمهای فوق قدرتمند را به دلیل خطراتی که برای جامعه و بشریت ایجاد میکنند، به مدت شش ماه متوقف کنند. چند روز قبل نیز «جفری هینتون» که او را «پدرخوانده هوش مصنوعی» مینامند، از سمت خود در گوگل استعفا کرد و گفت که از کار خود پشیمان است. او نسبت به خطرات این فناوری هشدار داد.

* این گزارش با استفاده از گزارش مجله «تایم» نوشته شده است.

برچسب ها:

نظر کاربران

نظری برای این پست ثبت نشده است.

مطالب مرتبط

بلاتکلیفی دانشآموزان در سایه جنگ

کنکوریها در انتظار یک تاریخ قطعی

به بهانه برگزاری دادگاه پژمان جمشیدی؛ چرا درک فرد آزاردیده از تجاوز و همراهی با او برای ما مشکل است؟

سمت درست تاریخ

فناوریهای نوین و همکاریهای منطقهای در نقشه راه تالابهای ایران

انقلاب خاموش در صنعت دارو

گفتوگو با «سید فؤاد توحیدی»، پژوهشگر موسیقی نواحی درباره ریشههای جغرافیایی و فرهنگی نغمههای جنوب

نغمههایی که از دریا میآینــــــد

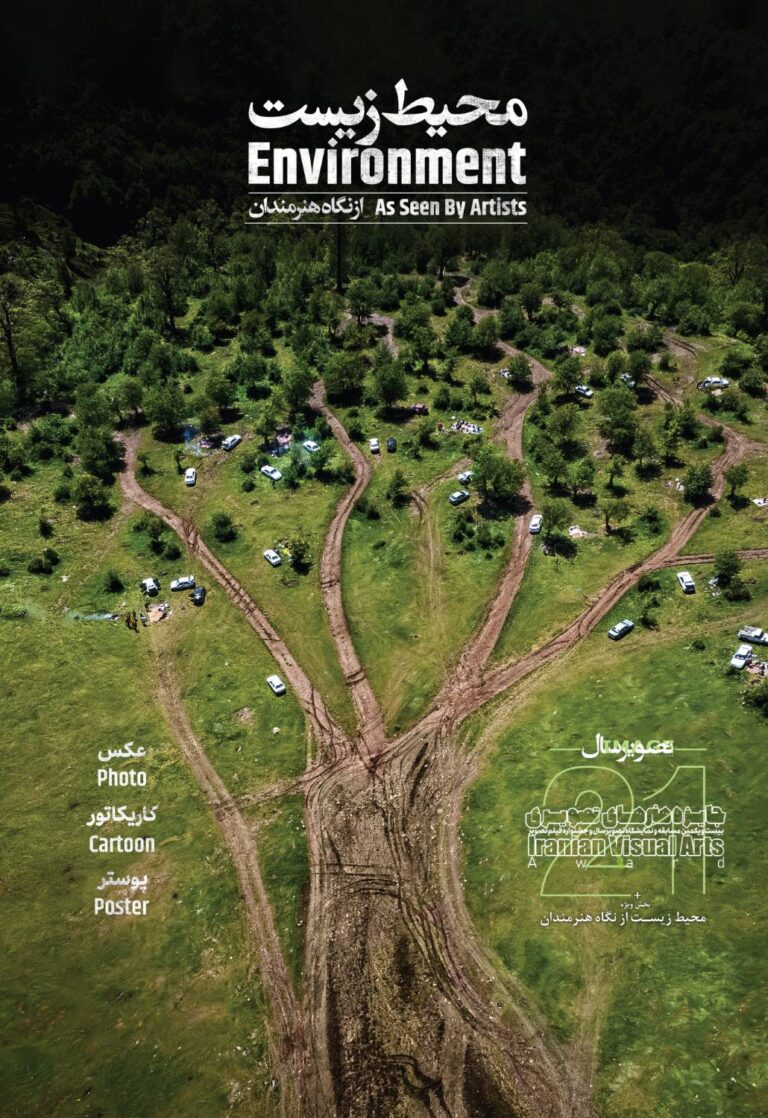

«محیطزیست از نگاه هنرمندان» منتشر شد

نگاهی به دغدغههای محیطزیستــی از دریچه تصاویر

در گفتوگو با «مهرداد زوارهمحمدی» معمار و پژوهشگر مطرح شد

خیابان؛ عرصه مشترک یا میدان تقابل؟

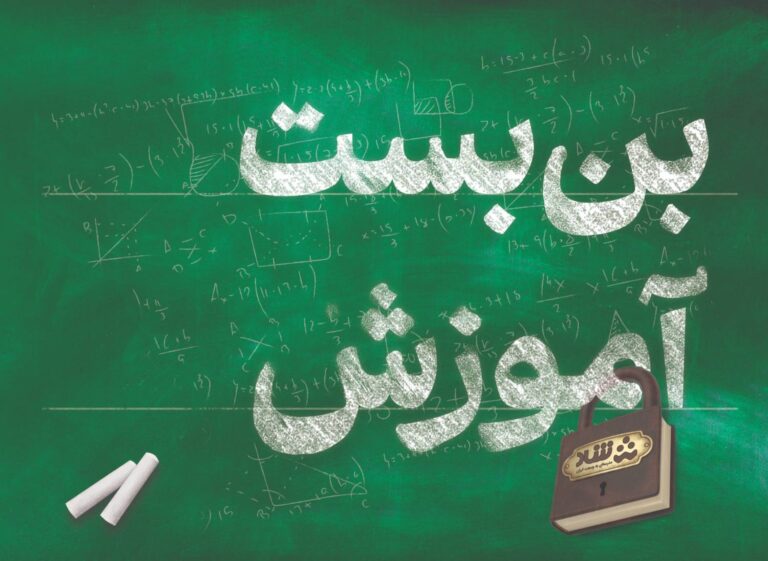

بنبست آموزش

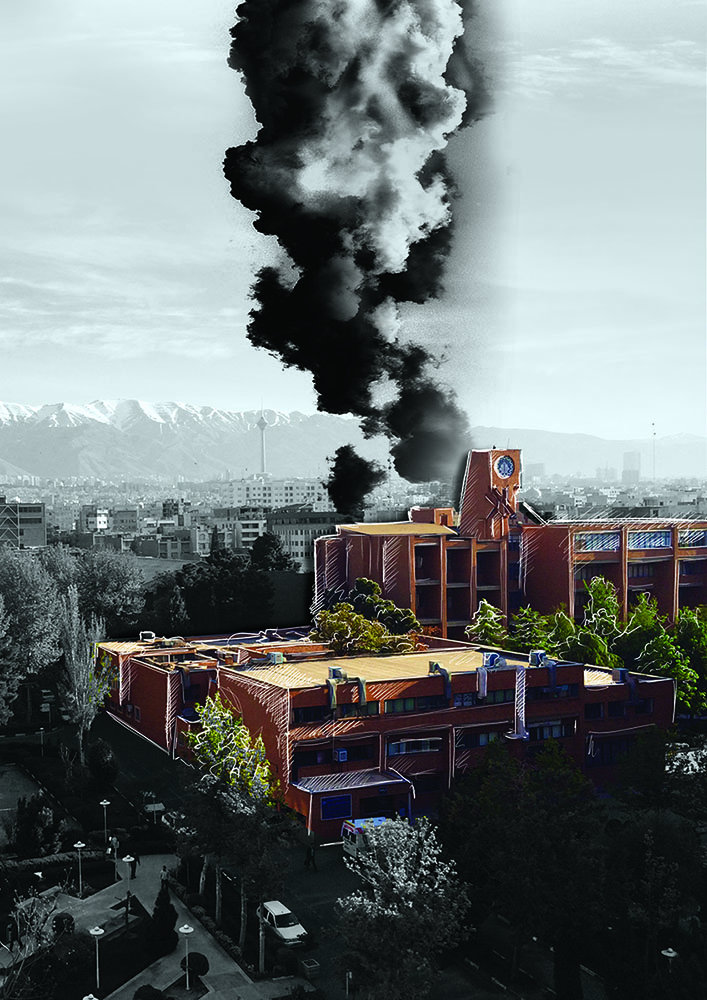

دراما در زمینِ سوخته

سینمای ایران و لکنت در روایت بحرانهای اقلیمی

شهرکرد؛ از شهر ملی تا قطب جهانی نمد

وب گردی

- مسابقه ملی ایدهپردازی «ایدانو» به آنتن شبکه دو رسید

- «سهم ما از قدردانی»؛ حمایت ویژه هتلهای دُنسه از قهرمانان امداد

- درخواست ایجاد مسیر دوچرخهسواری ۱۰۰ کیلومتری در قم

- چند روز بعد از سمپاشی ساس از بین میرود؟ (راهنمای کامل سمپاشی ساس + قوی ترین سم ساس)

- باغ پرندگان تهران کجاست؟ معرفی، ساعت کاری و آدرس

- مقایسه قیمت ورق شیروانی، سیاه، استیل و گالوانیزه در یک نگاه

- درخواست برقراری دورکاری و تعطیلی پنجشنبه برای کادر غیرعملیاتی (پشتیبانی) درمان سازمان تأمین اجتماعی

- طریقه ی ساخت دستگاه واکس زن برقی

- خرید لوازم یدکی لودر فابریک

- حضور فعال شرکت کرچنر سولار گروپ ایرانیان در نمایشگاه بینالمللی انرژیهای تجدیدپذیر بیشتر

بیشترین نظر کاربران

خیابان؛ عرصه مشترک یا میدان تقابل؟

پربازدیدها

1

رقص سوگوارانه؛ کنشی مقاومتی

2

رقص عزا

3

مبارزه با جستوجوی گنج

4

هوای آلوده با موتورهای منسوخشده و آلاینده خودروهای داخلی

5

گنجِ گمشده زیر چرخ لودرها

دیدگاهتان را بنویسید