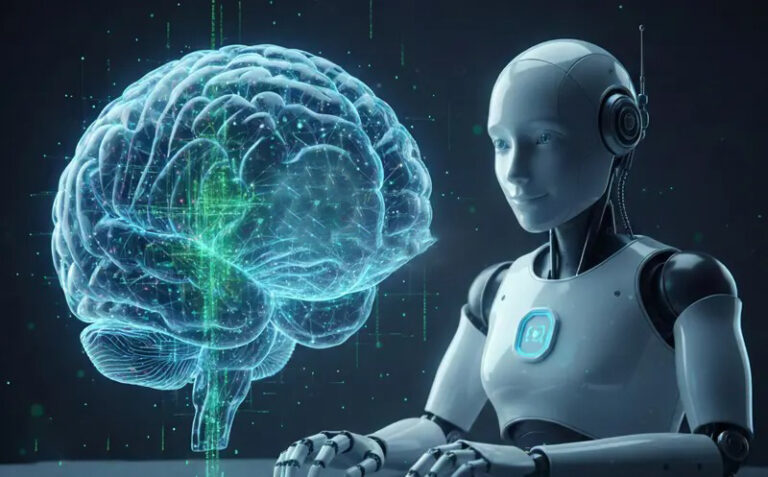

پژوهش جدید: الگوریتمهای غیرقابل ردیابی، حقوق بشر را نقض میکنند

هوش مصنوعی، تهدیدی برای کرامت انسانی

۳ مرداد ۱۴۰۴، ۲۱:۲۷

پژوهشی جدید نشان میدهد که هوش مصنوعی، با وجود تسهیل زندگی، کرامت انسانی را در مقیاس جهانی تهدید میکند و الگوریتمهای غیرقابل ردیابی آن، حقوق بشر را نقض میکنند.

مطالعهای به رهبری دانشگاه چارلز داروین استرالیا نشان داده است که هوش مصنوعی، در حالی که تعاملات ما را دگرگون کرده، ارزشهای دموکراتیک را تضعیف و سوگیریهای سیستماتیک را تشدید میکند. ماریا راندازو، پژوهشگر دانشکده حقوق این دانشگاه و نویسنده اصلی این مطالعه، معتقد است که سرعت تغییر چشماندازهای حقوقی و اخلاقی غرب توسط این فناوری بیسابقه است.

به گفته راندازو، مقررات فعلی قادر به حفاظت از حقوق و آزادیهای اساسی انسان مانند حریم خصوصی، منع تبعیض، استقلال کاربران و حقوق مالکیت فکری در مقابل هوش مصنوعی نیستند. دلیل اصلی این ناتوانی، غیرقابل ردیابی بودن بسیاری از مدلهای الگوریتمی است که راندازو آن را “مشکل جعبه سیاه” مینامد. وی میگوید: “ردیابی تصمیمات گرفتهشده توسط فرآیندهای یادگیری عمیق یا یادگیری ماشین، برای انسانها ناممکن است.” این امر تشخیص تخلف مدلهای هوش مصنوعی از حقوق انسان را دشوار و پیگیری حقوقی را عملاً ناممکن میسازد.

راندازو هشدار میدهد که این مشکل بدون تنظیم مقررات مناسب، بدتر خواهد شد و تأکید میکند که هوش مصنوعی مانند انسان نمیاندیشد. به گفته وی، “هوش مصنوعی یک دستاورد مهندسی است، نه رفتاریشناختی. نمیداند چه کاری و به چه دلیلی انجام میدهد؛ اصلاً مثل انسانها فکر نمیکند، فقط الگوها را میشناسد، بدون تجسد، حافظه، همدلی یا خرد.”

در حال حاضر، سه قدرت برتر دیجیتال جهان (آمریکا، چین و اتحادیه اروپا) رویکردهای متفاوتی نسبت به هوش مصنوعی دارند: آمریکا بازارمحور، چین دولتمحور و اتحادیه اروپا انسانمحور. راندازو رویکرد اتحادیه اروپا را برای حفاظت از کرامت انسانی ترجیح میدهد، اما معتقد است بدون تعهد جهانی، این رویکرد نیز کافی نخواهد بود. وی هشدار میدهد که اگر توسعه هوش مصنوعی با ویژگیهای انسانی مانند توانایی انتخاب، احساس، استدلال همراه با مراقبت، همدلی و دلسوزی همراه نشود، انسانیت به داده صرف تقلیل مییابد و انسان، وسیلهای برای رسیدن به هدف خواهد شد.

منبع : وبگاه فیز

برچسب ها:

نظر کاربران

نظری برای این پست ثبت نشده است.

مطالب مرتبط

نشست «اینترنت» کارزار با حضور فعالان این حوزه و در غیبت مسئولان برگزار شد

محدودیتِ بـــدونِ شفافیـت

فناوریهای نوین و همکاریهای منطقهای در نقشه راه تالابهای ایران

انقلاب خاموش در صنعت دارو

سلامت عمومی قربانی پنهان قطع اینترنت

دسترسی نابرابر به اینترنت در سایه «پرو» شدن اتصالها

زندگی پشت دیـــــــوار اختلال

بیانیه انجمن تجارت الکترونیک در مخالفت با ادامه قطعی اینترنت

رمزگشایی از «کتابخانه پنهان» در استخوانهای کهن

میـــــــــراث بیولوژیک

قطع اینترنت؛ از خسارت به کسبوکارها تا تخلف اپراتورها در دریافت وجوه اضافی

علم در برابر ادعا: چرا رادارهای نظامی عامل کاهش بارش در ایران نیستند؟

سیاستگذاری فناوری در پیچ تاریخی

شورش محلی علیه غولهای هوش مصنوعی

وب گردی

- «سهم ما از قدردانی»؛ حمایت ویژه هتلهای دُنسه از قهرمانان امداد

- درخواست ایجاد مسیر دوچرخهسواری ۱۰۰ کیلومتری در قم

- چند روز بعد از سمپاشی ساس از بین میرود؟ (راهنمای کامل سمپاشی ساس + قوی ترین سم ساس)

- باغ پرندگان تهران کجاست؟ معرفی، ساعت کاری و آدرس

- مقایسه قیمت ورق شیروانی، سیاه، استیل و گالوانیزه در یک نگاه

- درخواست برقراری دورکاری و تعطیلی پنجشنبه برای کادر غیرعملیاتی (پشتیبانی) درمان سازمان تأمین اجتماعی

- طریقه ی ساخت دستگاه واکس زن برقی

- خرید لوازم یدکی لودر فابریک

- حضور فعال شرکت کرچنر سولار گروپ ایرانیان در نمایشگاه بینالمللی انرژیهای تجدیدپذیر

- جدیدترین تغییرات قیمت ارزهای دیجیتال و تحلیل رفتار بازار جهانی بیشتر

بیشترین نظر کاربران

قطع اینترنت؛ از خسارت به کسبوکارها تا تخلف اپراتورها در دریافت وجوه اضافی

پربازدیدها

1

رقص سوگوارانه؛ کنشی مقاومتی

2

رقص عزا

3

مبارزه با جستوجوی گنج

4

هوای آلوده با موتورهای منسوخشده و آلاینده خودروهای داخلی

5

گنجِ گمشده زیر چرخ لودرها

دیدگاهتان را بنویسید